No importa lo que suceda con la IA generativa, sus fuerzas disruptivas ya están empezando a desempeñar un papel en la rápida carrera presidencial de los Estados Unidos.

LA INTELIGENCIA ARTIFICIAL ERAuna vez algo que la persona promedio describió en abstracto. No tenían ninguna relación táctil con él de la que fueran conscientes, incluso si sus dispositivos a menudo lo utilizaban. Todo eso ha cambiado durante el último año a medida que la gente ha comenzado a participar en programas de IA como DALL-E y ChatGPT de OpenAI, y la tecnología está avanzando rápidamente.

A medida que la IA se democratiza, la democracia en sí misma está cayendo bajo nuevas presiones. Es probable que haya muchas formas emocionantes de que se despliegue, pero también puede comenzar a distorsionar la realidad y podría convertirse en una gran amenaza para las elecciones presidenciales de 2024 si proliferan el audio, las imágenes y los videos de los candidatos generados por la IA. La línea entre lo que es real y lo que es falso podría comenzar a difuminarse significativamente más de lo que ya lo ha hecho en una era de desinformación desenfrenada.

«Hemos visto cambios bastante dramáticos en el panorama cuando se trata de herramientas generativas, especialmente en el último año», dice Henry Ajder, un experto independiente en IA. «Creo que la escala de contenido que ahora estamos viendo que se está produciendo está directamente relacionada con esa dramática apertura de la accesibilidad».

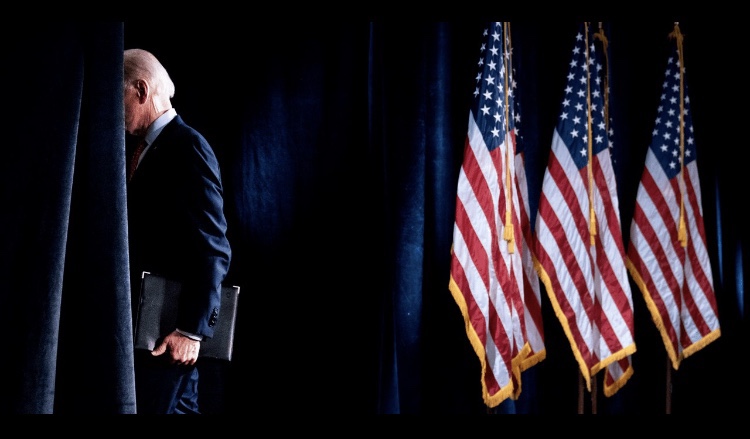

No se trata de si el contenido generado por la IA va a empezar a desempeñar un papel en la política, porque ya está sucediendo. Las imágenes y vídeos generados por la IA con el presidente Joe Biden y Donald Trump han comenzado a difundirse por Internet. Los republicanos utilizaron recientemente la IA para generar un anuncio de ataque contra Biden. La pregunta es, ¿qué pasará cuando alguien pueda abrir su computadora portátil y, con el mínimo esfuerzo, crear rápidamente una convincente falsificación profunda de un político?

Hay muchas maneras de generar imágenes de IA a partir de texto, como DALL-E, Midjourney y Stable Diffusion. Es fácil generar un clon de la voz de alguien con un programa de IA como el que ofrece ElevenLabs. Los vídeos deepfake convincentes siguen siendo difíciles de producir, pero Ajder dice que ese podría no ser el caso dentro de un año más o menos.

«Para crear un deepfake de muy alta calidad todavía se requiere un buen grado de experiencia, así como experiencia en postproducción para retocar la producción que genera la IA», dice Ajder. «El vídeo es realmente la próxima frontera en la IA generativa».

Algunas falsificaciones profundas de figuras políticas han surgido en los últimos años, como una del presidente ucraniano Volodymyr Zelenskyy que le dijo a sus tropas que se rindieran, que fue liberado el año pasado. Una vez que la tecnología haya avanzado más, lo que puede no llevar mucho tiempo teniendo en cuenta la rapidez con la que están avanzando otras formas de IA generativa, pueden aparecer más de este tipo de vídeos a medida que se vuelven más convincentes y fáciles de producir.

«No creo que haya un sitio web donde puedas decir: ‘Crérame un vídeo de Joe Biden diciendo X’. Eso no existe, pero lo hará», dice Hany Farid, profesora de la Escuela de Información de la UC Berkeley. «Es solo cuestión de tiempo. La gente ya está trabajando en el texto a vídeo».

Eso incluye empresas como Runway, Google y Meta. Una vez que una empresa lanza una versión de alta calidad de una herramienta de IA generativa de texto a vídeo, es posible que veamos que muchas otras lanzan rápidamente sus propias versiones, como lo hicimos después de que se lanzara ChatGPT. Farid dice que nadie quiere quedarse «dejado atrás», por lo que estas empresas tienden a publicar lo que tienen tan pronto como pueden.

«Siempre me sorprende que en el mundo físico, cuando lanzamos productos, haya pautas realmente estrictas», dice Farid. «No puedes lanzar un producto y esperar que no mate a tu cliente. Pero con el software, estamos como: «Esto realmente no funciona, pero veamos qué pasa cuando lo lanzamos a miles de millones de personas».

Si empezamos a ver un número significativo de deepfakes propagándose durante las elecciones, es fácil imaginar a alguien como Donald Trump compartiendo este tipo de contenido en las redes sociales y afirmando que es real. Una falsificación profunda del presidente Biden diciendo que algo descalificante podría salir poco antes de las elecciones, y es posible que muchas personas nunca se enteren de que fue generado por la IA. La investigación ha demostrado constantemente, después de todo, que las noticias falsas se propagan más allá de las noticias reales.

Incluso si los deepfakes no se vuelven ubicuos antes de las elecciones de 2024, que todavía faltan 18 meses, el mero hecho de que se pueda crear este tipo de contenido podría afectar a las elecciones. Saber que las imágenes, el audio y el vídeo fraudulentos se pueden crear con relativa facilidad podría hacer que la gente desconfíe del material legítimo que encuentren.

«En algunos aspectos, los deepfakes y la IA generativa ni siquiera necesitan estar involucrados en las elecciones para que todavía causen trastornos, porque ahora el pozo ha sido envenenado con esta idea de que cualquier cosa podría ser falsa», dice Ajder. «Eso proporciona una excusa realmente útil si surge algo inconveniente que te presenta. Puedes descartarlo como falso».

Entonces, ¿qué se puede hacer con este problema? Una solución es algo llamado C2PA. Esta tecnología firma criptográficamente cualquier contenido creado por un dispositivo, como un teléfono o una cámara de vídeo, y los documentos que capturaron la imagen, dónde y cuándo. La firma criptográfica se mantiene en un libro mayor inmutable centralizado. Esto permitiría a las personas que producen vídeos legítimos demostrar que, de hecho, son legítimos.

Algunas otras opciones incluyen lo que se llama huellas dactilares e imágenes y vídeos con marcas de agua. La toma de huellas dactilares implica tomar lo que se llama «hashes» del contenido, que esencialmente son solo cadenas de sus datos, para que pueda ser verificado como legítimo más adelante. La marca de agua, como es de esperar, implica insertar una marca de agua digital en imágenes y vídeos.

A menudo se ha propuesto que se puedan desarrollar herramientas de IA para detectar deepfakes, pero Ajder no está a la venta con esa solución. Dice que la tecnología no es lo suficientemente fiable y que no será capaz de mantenerse al día con las herramientas de IA generativa en constante cambio que se están desarrollando.

Una última posibilidad para resolver este problema sería desarrollar una especie de verificador de datos instantáneo para los usuarios de las redes sociales. Aviv Ovadya, investigador del Centro Berkman Klein para Internet y la Sociedad de Harvard, dice que podrías resaltar un contenido en una aplicación y enviarlo a un motor de contextualización que te informara de su veracidad.

«La alfabetización mediática que evoluciona al ritmo de los avances en esta tecnología no es fácil. Necesitas que sea casi instantáneo, donde miras algo que ves en línea y puedes obtener contexto sobre esa cosa», dice Ovadya. «¿Qué es lo que estás mirando? Podrías hacer una referencia cruzada con fuentes en las que puedas confiar».

Si ves algo que podría ser una noticia falsa, la herramienta podría informarte rápidamente de su veracidad. Si ves una imagen o un vídeo que parece que podría ser falso, podría comprobar las fuentes para ver si se ha verificado. Ovadya dice que podría estar disponible dentro de aplicaciones como WhatsApp y Twitter, o simplemente podría ser su propia aplicación. El problema, dice, es que muchos fundadores con los que ha hablado simplemente no ven mucho dinero en el desarrollo de una herramienta de este tipo.

Queda por ver si alguna de estas posibles soluciones se adoptará antes de las elecciones de 2024, pero la amenaza está creciendo, y se está invando mucho dinero para desarrollar la IA generativa y poco para encontrar formas de evitar la propagación de este tipo de desinformación.

«Creo que vamos a ver una avalancha de herramientas, como ya estamos viendo, pero creo que [el contenido político generado por la IA] continuará», dice Ajder. «Fundamentalmente, no estamos en una buena posición para lidiar con estas tecnologías increíblemente rápidas y potentes».

Fuente: https://www.wired.com/story/chatgpt-generative-ai-deepfake-2024-us-presidential-election/