Cada vez que un humano o una máquina aprende a mejorar en una tarea, se deja un rastro de evidencia. Una secuencia de cambios físicos, en las células de un cerebro o en los valores numéricos en un algoritmo, subyacen al rendimiento mejorado. Pero cómo el sistema descubre exactamente qué cambios hacer no es poca cosa. Se llama el problema de la asignación de crédito, en el que un cerebro o un sistema de inteligencia artificial debe identificar qué piezas en su tubería son responsables de los errores y luego hacer los cambios necesarios. En pocas palabras: es un juego de culpas encontrar quién tiene la culpa.

Los ingenieros de IA resolvieron el problema de la asignación de créditos para máquinas con un potente algoritmo llamado retropropagación, popularizado en 1986 con el trabajo de Geoffrey Hinton, David Rumelhart y Ronald Williams. Ahora es el caballo de batalla que impulsa el aprendizaje en los sistemas de IA más exitosos, conocidos como redes neuronales profundas, que tienen capas ocultas de «neuronas» artificiales entre sus capas de entrada y salida. Y ahora, en un artículo publicado en Nature Neuroscience en mayo, los científicos pueden finalmente haber encontrado un equivalente para cerebros vivos que podrían funcionar en tiempo real.

Un equipo de investigadores dirigido por Richard Naud de la Universidad de Ottawa y Blake Richards de la Universidad McGill y el Instituto Mila AI en Quebec revelaron un nuevo modelo del algoritmo de aprendizaje del cerebro que puede imitar el proceso de retropropagación. Parece tan realista que los neurocientíficos experimentales se han dado cuenta y ahora están interesados en estudiar neuronas reales para averiguar si el cerebro realmente lo está haciendo.

«Las ideas que provienen del lado más teórico pueden impulsar el impulso para hacer experimentos difíciles, y por mi dinero este periódico pasa por encima del listón por eso», dijo Matthew Larkum, neurocientífico experimental de la Universidad Humboldt de Berlín. «Es biológicamente plausible y podría tener grandes ramificaciones».

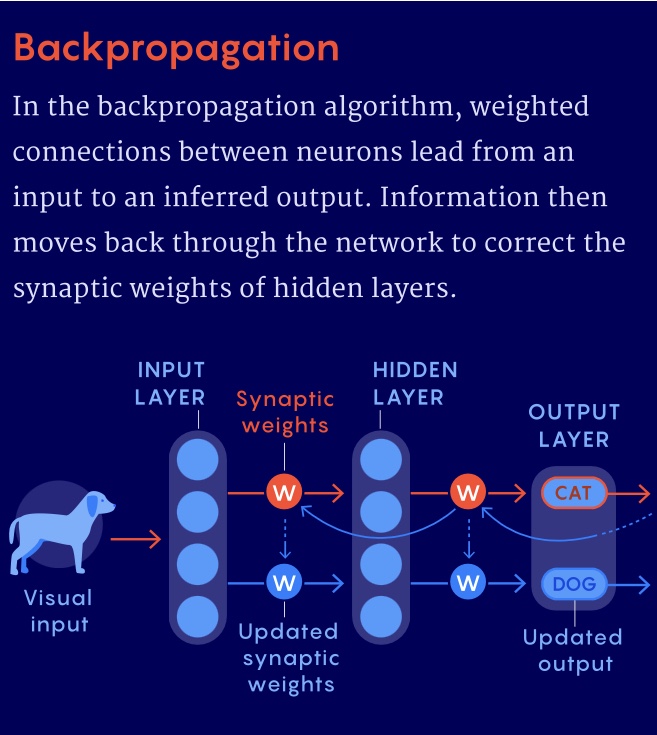

Sin embargo, los dos procesos no son exactamente los mismos. Cuando una red neuronal profunda se entrena para reconocer una imagen, procede en dos etapas: primero la propagación hacia adelante y luego la retropropagación, cuando se produce el «aprendizaje». Durante la primera etapa, las neuronas de la capa de entrada codifican las características de la imagen y la transmiten. Luego, las neuronas en las capas ocultas realizan cálculos y envían sus resultados a la capa de salida, que escupe su predicción de la imagen, como «gato». Pero si la imagen era realmente de un perro, entonces depende del algoritmo de retropropagación entrar y arreglar lo que salió mal ajustando los pesos que conectan las neuronas.

Estos cambios se basan en calcular cómo cada neurona podría contribuir menos al error general, comenzando con las neuronas en la parte superior, más cercanas a la capa de salida y luego retrocediendo a través de cada capa. Si el algoritmo de retropropagación estima que aumentar la actividad de una neurona dada mejorará la predicción de salida, por ejemplo, entonces los pesos de esa neurona aumentarán. El objetivo es cambiar todas las conexiones en la red neuronal, cada una un poco en la dirección correcta, hasta que las predicciones de salida sean correctas con más frecuencia.

Durante décadas, los investigadores habían tratado de averiguar cómo el cerebro podría realizar algo así como retropropagación para resolver el problema de la asignación de crédito. La retropropagación en sí no es biológicamente plausible porque, entre otras cosas, las neuronas reales no pueden simplemente dejar de procesar el mundo externo y esperar a que comience la retropropagación; si lo hicieran, terminaríamos con fallos en nuestra visión o audición.

El nuevo modelo de Naud y Richards eludió esto con un simple cambio en la comprensión canónica de cómo las neuronas se comunican entre sí. Durante mucho tiempo sabemos que las neuronas actúan como bits, capaces de solo dos salidas, ya sea enviando un aumento de actividad eléctrica a otra neurona o no enviándola, ya sea un 1 o un 0. Pero también es cierto que las neuronas pueden enviar una «explosión» de picos en rápida sucesión. Y hacerlo se ha demostrado que cambia las conexiones entre las neuronas, haciendo de las explosiones un candidato natural para resolver el problema de la asignación de créditos. En el nuevo modelo, el equipo consideró que las ráfagas de neuronas eran una tercera señal de salida, una corriente de 1s tan cerca que efectivamente se convierte en un 2. En lugar de codificar nada sobre el mundo externo, los 2 actúan como una «señal de enseñanza» para decirle a otras neuronas si deben fortalecer o debilitar sus conexiones entre sí, en función del error acumulado en la parte superior del circuito.

Pero para que esta señal de enseñanza resolviera el problema de la asignación de crédito sin golpear la «pausa» en el procesamiento sensorial, su modelo requería otra pieza clave. El equipo de Naud y Richards propuso que las neuronas tienen compartimentos separados en su parte superior e inferior que procesan el código neuronal de maneras completamente diferentes.

«[Nuestro modelo] muestra que realmente puedes tener dos señales, una subiendo y otra bajando, y pueden pasar entre sí», dijo Naud.

Para que esto sea posible, su modelo postula que las ramas arbóreas que reciben entradas en la parte superior de las neuronas solo escuchan ráfagas, la señal de enseñanza interna, para sintonizar sus conexiones y disminuir el error. La afinación ocurre de arriba hacia abajo, al igual que en la retropropagación, porque en su modelo, las neuronas en la parte superior están regulando la probabilidad de que las neuronas debajo de ellas envíen una ráfaga. Los investigadores mostraron que cuando una red tiene más ráfagas, las neuronas tienden a aumentar la fuerza de sus conexiones, mientras que la fuerza de las conexiones tiende a disminuir cuando las señales de ráfaga son menos frecuentes. La idea es que la señal de explosión le diga a las neuronas que deben estar activas durante la tarea, fortaleciendo sus conexiones, si hacerlo disminuye el error. La ausencia de ráfagas le dice a las neuronas que deben estar inactivas y pueden necesitar debilitar sus conexiones.

Al mismo tiempo, las ramas en la parte inferior de la neurona tratan las ráfagas como si fueran espigas simples, la señal mundial externa normal, lo que les permite continuar enviando información sensorial hacia arriba en el circuito sin interrupción.

«En retrospectiva, la idea presentada parece lógica, y creo que esto habla de su belleza», dijo João Sacramento, neurocientífico computacional de la Universidad de Zurich y ETH Zurich. «Creo que eso es brillante».

Otros habían intentado seguir una lógica similar en el pasado. Hace veinte años, Konrad Kording de la Universidad de Pensilvania y Peter König de la Universidad de Osnabrück en Alemania propusieron un marco de aprendizaje con neuronas de dos compartimentos. Pero su propuesta carecía de muchos de los detalles específicos del modelo más nuevo que son biológicamente relevantes, y era solo una propuesta: no podían probar que realmente pudiera resolver el problema de la asignación de crédito.

«En ese entonces, simplemente carecíamos de la capacidad de probar estas ideas», dijo Kording. Considera que el nuevo documento es «tremendo trabajo» y lo hará un seguimiento en su propio laboratorio.

Con el poder computacional actual, Naud, Richards y sus colaboradores simularon con éxito su modelo, con neuronas explosivas jugando el papel de la regla de aprendizaje. Demostraron que resuelve el problema de asignación de crédito en una tarea clásica conocida como XOR, que requiere aprender a responder cuando una de las dos entradas (pero no ambas) es 1. También mostraron que una red neuronal profunda construida con su regla de estallido podría aproximarse al rendimiento del algoritmo de retropropagación en tareas desafiantes de clasificación de imágenes. Pero todavía hay margen de mejora, ya que el algoritmo de retropropagación era aún más preciso, y ninguno de los dos coincide completamente con las capacidades humanas.

«Tiene que haber detalles que no tenemos, y tenemos que mejorar el modelo», dijo Naud. «El objetivo principal del artículo es decir que el tipo de aprendizaje que están haciendo las máquinas se puede aproximar mediante procesos fisiológicos».

Los investigadores de IA también están entusiasmados, ya que averiguar cómo el cerebro se aproxima a la retropropagación también podría mejorar en última instancia la forma en que aprenden los sistemas de IA. «Si lo entendemos, entonces esto puede conducir eventualmente a sistemas que puedan resolver problemas computacionales de la manera más eficiente que el cerebro», dijo Marcel van Gerven, presidente del departamento de inteligencia artificial del Instituto Donders de la Universidad Radboud en los Países Bajos.

El nuevo modelo sugiere que la asociación entre la neurociencia y la IA también podría ir más allá de nuestra comprensión de cada uno solo y, en su lugar, encontrar los principios generales que son necesarios para que los cerebros y las máquinas puedan aprender cualquier cosa.

«Estos son principios que, al final, trascienden el wetware», dijo Larkum.

Fuente: https://www.quantamagazine.org/brain-bursts-can-mimic-famous-ai-learning-strategy-20211018/